您是否正在思考如何安装OpenClaw?本指南将带您逐步完成在Mac和Windows系统上从安装、部署再到如何个性化配置使用OpenClaw的流程。无论您使用的是macOS还是Windows系统,这里都将为您提供所有必要步骤,助您立即启动并运行时下最热人工智能助手!

什么是OpenClaw AI?

OpenClaw AI是一款前沿的人工智能框架。它主要由开发者用于构建、训练和部署高级机器学习模型。此外,其高度灵活的架构设计,意味着您能轻松将其集成到现有软件环境中。

OpenClaw 不是传统意义上的模型训练框架,而是一个自托管网关。它运行在你的电脑或服务器上,把 Telegram、WhatsApp、Discord、iMessage 等聊天应用连接到 AI 助手。本文将聚焦两件事:在 Windows / macOS 上完成安装,以及确认 Gateway 成功运行。后续的聊天平台接入和模型配置,会给出最短可用路径。

延伸阅读:2026年10个最好用的免费 AI 聊天APP(实测推荐)

安装OpenClaw前的准备工作

启动部署流程前,请确保系统满足以下要求:

- Node.js: Node 22 或更高版本(如未安装,安装脚本可自动处理)

- WSL2:针对Windows用户

- OpenClaw.app:推荐macOS用户使用

- Homebrew(仅限Mac):简化macOS软件安装的包管理器。

- Ollama(可选):若要使用本地大型语言模型(如Deepseek或Minimax)的环境,可避免云端成本支出。

注意:如果需要通过连接Ollama运行OpenClaw本地模型,这对用户的设备硬件要求较高,但如果只是普通用户,设备的硬件能力有限,可结合自身个性化需要选择最具性价比的在线api模型,可参考下文中的API模型推荐列表。

如何在Windows上安装OpenClaw

请按以下步骤在 Windows 设备上成功安装 OpenClaw:

步骤1:以管理员身份运行 PowerShell

首先启动具有管理权限的 PowerShell。此操作至关重要,因为某些系统级脚本需要更高权限。

步骤2:设置执行策略

默认情况下,Windows 可能阻止脚本执行。为允许脚本运行,请在PowerShell中执行以下命令并输入“Y”确认更改:

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser

步骤3:使用单行安装程序

复制粘贴安装命令:

“iwr -useb https://openclaw.ai/install.ps1 | iex”。

该脚本将自动检测操作系统,并在缺失时安装 Node.js。

注意:Windows Defender 或防火墙偶尔会标记 Node 应用,若遇到配对问题,请确保防火墙未阻止 localhost 连接。

步骤4:完成入门流程

安装完成后,终端将提示您完成入门流程。您需要:

- 确认在系统上运行AI代理的安全许可。

- 选择“快速启动”模式以加速配置。

- 选择模型。若使用Ollama,可暂时跳过模型选择或手动输入虚拟模型完成配置。

延伸阅读:2026年十大免费AI代码生成器

如何在macOS上安装OpenClaw

无论使用Apple Silicon(M1/M2/M3/M4)还是英特尔芯片,在macOS部署OpenClaw均可实现无缝体验:

步骤1:打开终端

通过Spotlight搜索启动Mac终端应用。

步骤2:执行Curl命令

运行单行Curl安装命令:

“curl -fsSL https://openclaw.ai/install.sh | bash”

该命令将自动检测并安装Homebrew和Node.js(若未安装)。

步骤3:理解安全提示

Mac用户将收到基于“最小权限”原则的安全提示。使用方向键导航提示框,选择是继续。

步骤4:选择操作界面

OpenClaw提供终端用户界面(TUI)和网页界面两种模式。为获得精简体验,可选择“在TUI中孵化”,通过终端直接与AI助手交互。

如何将OpenClaw 连接到 Ollama(双平台适用)

若需脱离云端在本地运行模型,需将 OpenClaw 与 Ollama 集成:

步骤1:安装 Ollama

从 Ollama 官网下载并安装。该工具是本地运行 Deepseek、Minimax 等模型的必要组件。

步骤2:通过Ollama启动OpenClaw

若需使用特定模型启动OpenClaw,请执行以下命令:

openclaw –model Minimax

选择Deepseek或Minimax等模型进行下载与初始化。

步骤3:确保仅运行单一网关

若遇到端口错误,请确认未运行其他OpenClaw网关实例。使用以下命令停止现有实例:openclaw stop。

访问Web控制面板

网关启动后,可通过浏览器访问OpenClaw图形界面:

步骤1:获取令牌

在您的用户主目录中打开路径为~/.openclaw/openclaw.json的文件以进行配置,查找专属网关令牌。需注意的是该文件会被 Gateway 监控,很多改动可自动生效,操作时需谨慎。

步骤2:打开浏览器

在浏览器中访问 http://127.0.0.1:18789,即可进入 OpenClaw 本地控制面板。如若启用了鉴权,再在 UI 中填入 token。

步骤3:选择 AI 模型

您需选择服务提供商(如 Anthropic 或 OpenAI)。使用 OAuth 通常比配置原始 API 密钥更顺畅。您还可设置与智能体交互的渠道(如 Telegram、Discord、WhatsApp)。

重要提示:OpenClaw 会提示 AI 智能体将在您的设备上执行真实命令。请谨慎操作!

安装后快速验证

如您已严格按照上述步骤完成了安装,但不确定您是否已经装好,或者它是否能够正常运作,可参考一下步骤快速验证。

第一步:检查服务状态

在终端依次运行以下命令:

“openclaw gateway status”

“openclaw status”

“openclaw health”

正常情况下你应看到类似以下结果:

- gateway: running

- status: running

- health: healthy

只要服务状态为 running 且 health 为 healthy,说明核心组件已成功启动。

第二步:访问本地控制界面

在浏览器中打开:

http://127.0.0.1:18789/

如果页面成功加载 Control UI 管理界面,说明:

- Gateway 已启动

- 本地端口监听正常

- OpenClaw 可以正常使用

这种方式比直接查找 token 更直观,更适合新用户快速确认安装结果。

常见问题排查

如果无法访问页面:

- 再次确认“openclaw status” 是否显示 running

- 检查本地防火墙是否阻止 18789 端口

- 尝试重启服务:

“openclaw restart”

快速判断标准

满足以下三项即可确认安装成功:

- openclaw status 显示 running

- openclaw health 显示 healthy

- 浏览器可以正常打开 http://127.0.0.1:18789/

完成以上步骤,即可确认 OpenClaw 安装成功并正常运行。

如何将OpenClaw连接至聊天平台(以Telegram、WhatsApp为例)

在OpenClaw中正确配置API后,下一步是将其与您偏好的聊天平台集成。以下以Telegram、WhatsApp为例,提供完整的分步指南,助您完成最终设置。

步骤1:准备机器人bot或应用程序凭证

在将OpenClaw连接至任何平台前,您需先在该平台创建机器人或应用程序。

Telegram操作指南

- 打开Telegram并搜索BotFather。

- 发起聊天并输入“/newbot”。

- 按提示操作:

- 命名您的机器人

- 创建用户名

- 复制生成的机器人令牌。

此令牌将在OpenClaw中使用。

WhatsApp平台

WhatsApp集成通常需要:

- WhatsApp商务API

- 第三方服务提供商

- Webhook配置

请确保获取:

- API密钥

- Webhook网址

- 手机号码ID(如需)

步骤2:在OpenClaw配置Webhook或API

返回OpenClaw界面。

- 打开平台集成设置

- 选择目标平台(Telegram/Discord/WhatsApp等)

- 粘贴以下信息:

- 机器人令牌

- Webhook网址(如需)

- 频道或聊天ID

若需配置Webhook:

- 将Webhook URL设置为:https://your-server-address/webhook

- 确保您的服务器支持HTTPS。

步骤3:启用消息路由

在OpenClaw内:

- 进入消息路由/自动化

- 选择:

- 默认模型

- 触发规则(例如:回复所有消息或仅在被提及时响应)

- 保存设置。

此操作确保聊天平台的消息转发至您选定的API模型。

步骤4:测试机器人

前往您选择的平台:

- 向机器人发送消息

- 等待响应

若配置正确:

- 消息 > OpenClaw > API > 响应 > 聊天平台

您将在数秒内收到回复。

步骤5:定制行为 (可选但推荐)

优化用户体验:

1. 设置系统提示

示例:

您是高效的AI助手,请清晰简洁地回复。

2. 设置速率限制

通过限制以下指标防止垃圾信息:

- 每分钟请求数

- 每对话令牌消耗量

3. 添加命令触发器

例如:

- /help

- /reset

- /summary

此举可提升机器人专业度。

步骤6:监控日志与使用情况

确保稳定性:

- 检查API使用限制

- 监控错误日志

- 重点关注:

- 401错误(密钥无效)

- 429错误(速率限制)

- 超时错误

保持日志清洁可保障长期稳定性。

步骤7:上线前最终检查

正式启用前请确认所有配置无误:验证API密钥有效性、机器人令牌正确性、网络钩子处于活动状态且可访问、已选择合适模型、消息路由功能完全启用。当所有组件均通过验证并协同运行顺畅时,您的OpenClaw集成即可在所选聊天平台上可靠运行。

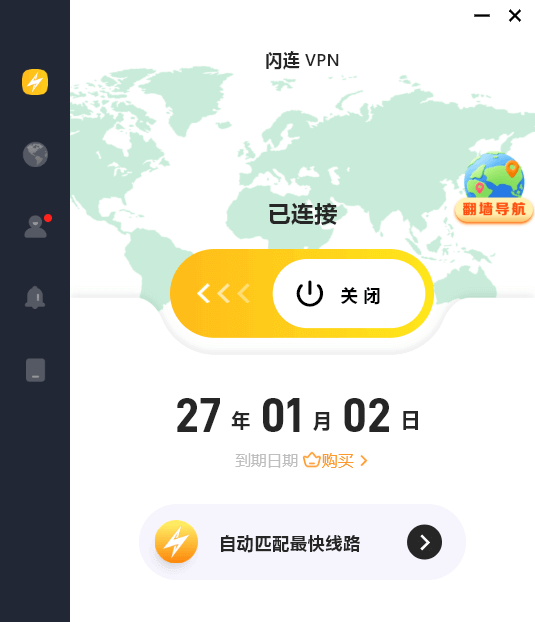

如何通过VPN来优化OpenClaw部署与使用

部署OpenClaw时,尤其是访问国际AI模型时,VPN发挥着关键作用:

访问国际AI模型

若您在中国等网络受限地区使用OpenClaw,闪连VPN是理想解决方案。其全球覆盖2000+服务器节点,可突破地域封锁访问OpenAI(ChatGPT)、Google Gemini、Midjourney及Stable Diffusion等国际AI模型。凭借强加密技术与高隐私标准,确保对海外AI模型的API调用安全无忧。

保障AI执行流畅性

针对OpenClaw性能需求,闪连VPN提供无速限的高速稳定连接,有效降低延迟并杜绝中断。同时解锁全球社交媒体与流媒体平台,轻松获取外部数据源。

此外,它支持Windows、macOS、Linux等多平台,确保跨设备无缝运行。对于非受限区域用户,它还能通过解锁AI代理执行过程中所需的网站与服务,全面提升整体性能。

AI API模型选择清单(低价格优先排序)

| 厂商 | 代表型号 | 官网 | 价格(输入 / 输出) | 综合价格 | 核心优势 | 备注 |

|---|---|---|---|---|---|---|

| Qwen(阿里) | qwen-turbo | dashscope.aliyun.com | $0.05 / $0.20 | $0.25 | 价格极低;中文友好 | 适合预算敏感型项目 |

| OpenAI | gpt-5-nano | developers.openai.com | $0.05 / $0.40 | $0.45 | 生态最成熟;兼容性最佳 | 极低成本入门选择 |

| GLM(智谱 Z.AI) | GLM-4.7-FlashX | bigmodel.cn / docs.z.ai | $0.07 / $0.40 | $0.47 | 中文友好;轻量级 Agent | 适合国内迁移 |

| Gemini 2.5 Flash-Lite | ai.google.dev | $0.10 / $0.40 | $0.50 | 低延迟;支持多模态 | 配置细节稍复杂 | |

| xAI | grok-4-1-fast-reasoning | x.ai/api | $0.20 / $0.50 | $0.70 | 工具调用能力强 | 工具单独计费 |

| DeepSeek | deepseek-chat | platform.deepseek.com | $0.27 / $1.10 | $1.37 | 性价比均衡 | 基于缓存未命中计费 |

| Qwen(阿里) | qwen-plus(非思考模式) | dashscope.aliyun.com | $0.40 / $1.20 | $1.60 | 更加均衡;中文能力更强 | 思考模式价格更高 |

| OpenAI | gpt-5-mini | developers.openai.com | $0.25 / $2.00 | $2.25 | 更稳定、更强大 | 提供默认模型选项 |

| GLM(智谱 Z.AI) | GLM-4.7 | bigmodel.cn / docs.z.ai | $0.60 / $2.20 | $2.80 | 更强的多步骤执行能力 | 比 FlashX 更贵 |

| Anthropic | Claude Haiku 4.5 | platform.claude.com | $1.00 / $5.00 | $6.00 | 质量高;速度快 | 低价模型相对仍较贵 |

OpenClaw API集成三大推荐

TOP 1: Qwen qwen-turbo:绝对低价之王,中文场景友好。

TOP 2: DeepSeek deepseek-chat:综合表现最均衡,价格实惠,兼容OpenAI,易于集成,输出成本远低于多数中高阶模型。

TOP 3: OpenAI gpt-5-nano:超低价+最标准的API生态,管理最便捷。

补充建议:若您不仅追求绝对最低价,更注重“性价比”,可考虑将DeepSeek的deepseek-chat作为默认主模型。

结语

只要步骤正确,在Mac和Windows上配置OpenClaw都相当简单。本指南已为您提供在设备上部署OpenClaw所需的一切内容,并推荐了能提升体验的AI模型。立即开始部署您的AI助手吧!