DeepSeek — это отличное AI-приложение. Однако по разным причинам энтузиасты ИИ хотят развернуть его локально на своих устройствах. Сегодня мы расскажем, как загрузить DeepSeek на разные устройства, чтобы вы могли получить более удобный и конфиденциальный опыт общения с ИИ.

Безопасно ли скачивать DeepSeek?

Является ли DeepSeek безопасным? Согласно его политике конфиденциальности, остаются некоторые неопределённости в отношении управления определёнными данными. Например, в политике указано, что пользовательские данные хранятся на защищённых серверах в Китае. Однако не уточняется, как долго они будут сохраняться и возможно ли их полное удаление.

Тем не менее, учитывая прецеденты с такими платформами, как TikTok, Xiaohongshu и Lemon8, крайне маловероятно, что с пользовательскими данными в DeepSeek возникнут серьёзные проблемы. Однако, если вы разместите на платформе неподобающий контент, ваши данные могут быть переданы властям.

Таким образом, если вас не устраивает политика конфиденциальности DeepSeek, локальное развертывание на вашем компьютере может стать хорошей альтернативой.

Совет:

Другой вариант защиты ваших данных — использование VPN, например, LightningX VPN. Это отличный VPN для AI-инструментов, таких как ChatGPT, Gemini, Claude и DeepSeek. Он поддерживает Android, iOS, Windows, macOS, Linux, Apple TV и Android TV. С его помощью можно изменить местоположение, подключившись к 2 000 серверам в 50+ странах. VPN отличается удобством, высокой скоростью и надёжностью. Сейчас он предоставляет бесплатную пробную версию для новичков.

Системные требования для загрузки DeepSeek

Android:

- Процессор: Snapdragon 845, Qualcomm Snapdragon 8 Gen 2/3 или аналогичный.

- ОЗУ: 6 ГБ, 8 ГБ, 12 ГБ или больше.

- Хранилище: 8 ГБ, 12 ГБ или больше свободного места.

Примеры совместимых устройств: OnePlus 6, Samsung Galaxy S9, Xiaomi Pocophone F1, Google Pixel 3, Sony Xperia XZ2.

iOS:

- ОЗУ: 8 ГБ, 16 ГБ или больше.

- Для небольших моделей: iPhone 15 Pro и iPad Air с 8 ГБ ОЗУ.

- Для больших моделей: iPad Pro с 16 ГБ ОЗУ.

Windows:

- Операционная система: Windows 10 или новее.

- ОЗУ: минимум 8 ГБ (для небольших моделей, таких как 1.5B). Для больших моделей рекомендуется 16 ГБ или больше.

- Хранилище: SSD с минимум 50 ГБ свободного места.

- Видеокарта: NVIDIA с поддержкой CUDA (например, RTX 2060 или выше для лучшей производительности).

macOS:

- Операционная система: macOS 11 Big Sur или новее.

- Процессор: многопоточный CPU (рекомендуется Apple Silicon M1/M2 или Intel Core i5/i7/i9).

- ОЗУ: минимум 8 ГБ (16 ГБ рекомендуется для больших моделей).

- Хранилище: минимум 10 ГБ свободного места (50 ГБ и больше рекомендуется для больших моделей).

Скачать DeepSeek на Android и iOS

Чтобы использовать DeepSeek на мобильном устройстве, вы можете загрузить его напрямую из Google Play Store или App Store, либо скачать локальные файлы DeepSeek для работы в офлайн-режиме.

Загрузка через Google Play Store или App Store

Следуйте этим шагам, чтобы установить приложение DeepSeek:

- Найдите DeepSeek в Google Play Store или App Store на своём мобильном устройстве.

- Загрузите и установите приложение.

- Готово! Теперь вы можете создать аккаунт, включить модель R1 и начать работу с DeepSeek.

Запуск DeepSeek в офлайн-режиме на мобильном устройстве

Локальная загрузка DeepSeek на мобильные устройства требует терминальных эмуляторов, таких как:

- PocketPal AI (для Android и iOS) – самый удобный для новичков,

- Termux (для Android),

- Termius (для iOS).

Как использовать PocketPal AI для локального запуска DeepSeek.

- Установите PocketPal AI из Google Play Store или App Store.

- Откройте приложение и нажмите “Go to Models” в нижнем правом углу экрана.

- Нажмите “+” в нижнем правом углу, затем “Add from Hugging Face” – откроется библиотека моделей Hugging Face.

- Введите “DeepSeek” в строку поиска – появятся все AI-модели DeepSeek.

- Выберите и скачайте подходящую модель. Модель 7B – хороший сбалансированный вариант. Также проверьте системные требования, которые мы упомянули выше.

- После загрузки файла вернитесь на вкладку “Models” и убедитесь, что файл скачан.

- Нажмите “Settings” под загруженным файлом, В разделе N PREDICT установите 4096 токенов (для лучшей генерации и понимания), Нажмите “Save Changes”.

- Нажмите “Load” рядом с “Settings”.

- Готово! Теперь вы можете работать с локальной моделью DeepSeek через удобный графический интерфейс PocketPal AI.

Использование Ollama для загрузки DeepSeek на Windows/Mac/Linux

Ollama — один из самых простых инструментов для локального запуска LLM на компьютере. Процесс настройки DeepSeek с помощью Ollama на Windows, macOS и Linux практически идентичен. Установка состоит из двух основных этапов.

Шаг 1. Загрузка Ollama Desktop

Перейдите на Ollama.com и нажмите кнопку Download в правом верхнем углу. Выберите вашу операционную систему.

Для Windows можно установить Ollama напрямую.

Для macOS, так как загруженный файл имеет формат .dmg, перетащите иконку Ollama в папку Applications для завершения установки.

В среде Linux выполните следующие шаги:

Скопируйте и вставьте в терминал следующие команды поочередно. Каждая команда выполняет определенную задачу: первая устанавливает Ollama, вторая запускает службу Ollama, третья проверяет установку, выводя установленную версию.

- curl -fsSL https://ollama.com/install.sh | sh

- ollama serve

- ollama –version

Если установка Ollama прошла успешно, должно появиться отображение номера версии.

Примечание: Будьте осторожны при вводе команд в терминал или командную строку, так как некорректные команды могут привести к потере данных.

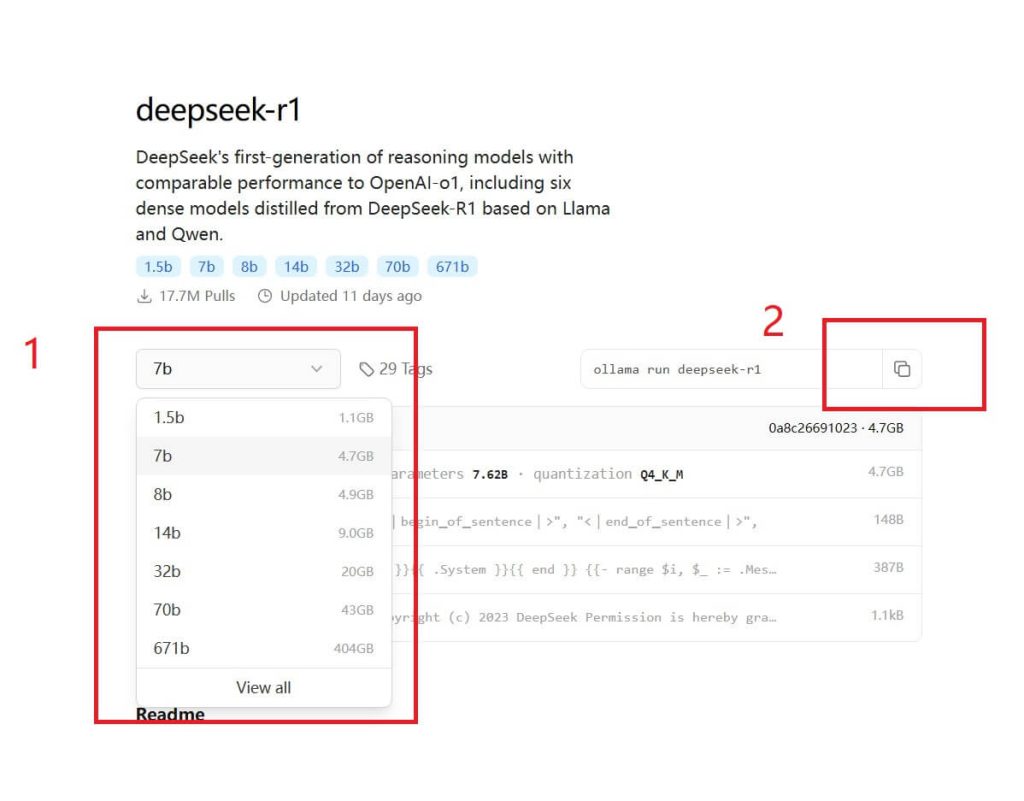

Шаг 2. Загрузка DeepSeek через командную строку

1. Откройте командную строку (Command Prompt) или терминал на своем компьютере.

2. Найдите нужную модель DeepSeek на сайте Ollama и скопируйте ее код. В библиотеке Ollama сейчас есть DeepSeek R1, Coder, V2.5, V3 и другие. Спецификации, требуемые для разных параметров, приведены во второй части этой статьи.

3. Вставьте код в командную строку или терминал и дождитесь установки модели DeepSeek.

4. Готово. Теперь вы можете вводить запросы и взаимодействовать с моделью DeepSeek AI.

5. Чтобы выйти из разговора, нажмите Ctrl + D.

Шаг 3. Если вы хотите общаться с DeepSeek через веб-интерфейс

Если вам нужен удобный интерфейс для общения с локальной моделью DeepSeek, установите Open WebUI, который работает с Ollama.

1. Установите и настройте Python и Pip на вашем компьютере.

2. Откройте командную строку или терминал и вставьте следующую команду для установки Open WebUI:

pip install open-webui

3. Запустите модель DeepSeek через Ollama. Например, для DeepSeek R1:

ollama run deepseek-r1:1.5b

4. Запустите Open WebUI:

open-webui serve

5. Перейдите в браузере по адресу http://localhost:8080.

6. Нажмите “Get started” и введите имя пользователя.

7. Готово. Теперь вы можете общаться с моделью DeepSeek через веб-интерфейс.

8. Чтобы завершить работу, щелкните правой кнопкой мыши по Ollama в системном трее и выберите “Quit Ollama”.

Использование LM Studio для загрузки DeepSeek R1 Distill на ваш компьютер

LM Studio также является инструментом для загрузки моделей DeepSeek, таких как DeepSeek Distill, DeepSeek Math и DeepSeek Coder. Вы можете посетить каталог моделей LM Studio, чтобы проверить доступные модели.

- Перейдите на LMStudio.ai и загрузите программное обеспечение (версия 0.3.9 или новее) для Mac, Windows или Linux.

- Запустите LM Studio и нажмите на значок поиска в левой панели.

- В разделе Model Search выберите модель DeepSeek R1 Distill (Qwen 7B) и нажмите кнопку Download. Эта модель использует 4.68 ГБ памяти, поэтому ваш ПК должен иметь как минимум 5 ГБ свободного места и 8 ГБ ОЗУ.

- После загрузки модели перейдите в окно Chat и загрузите модель.

- Нажмите кнопку Load Model. Можно установить параметр GPU offload в 0, чтобы избежать ошибок загрузки.

- Готово. Теперь вы можете использовать офлайн-версию DeepSeek на своем компьютере.

Как удалить DeepSeek из Ollama и LM Studio

Следуйте этому руководству, чтобы удалить локальную версию DeepSeek с вашего компьютера.

Удаление DeepSeek из Ollama

Шаг 1. Откройте командную строку (Command Prompt) или терминал на вашем компьютере.

Шаг 2. Остановите службу Ollama, если она работает.

ollama stop

Шаг 3. Проверьте, какие модели DeepSeek у вас установлены:

ollama list

Шаг 4. Удалите установленную модель DeepSeek. Например, для DeepSeek R1:

ollama remove deepseek-r1

Шаг 5. Готово. Если модель не удаляется, проверьте ее имя еще раз.

Шаг 6. Перейдите в файловый менеджер, чтобы удалить остаточные файлы модели DeepSeek, которые находятся в:

- Linux/macOS: ~/ollama/models/

- Windows: C:\Users<YourUsername>\ollama\models\

Удаление DeepSeek из LM Studio

Шаг 1. Откройте программу LM Studio.

Шаг 2. Перейдите на вкладку My Models в левой панели.

Шаг 3. Найдите установленную модель DeepSeek.

Шаг 4. Нажмите на три точки рядом с названием модели.

Шаг 5. Выберите Delete и подтвердите удаление, нажав Delete снова.

Шаг 6. Проверьте, удалены ли файлы DeepSeek:

- Windows: C:\Users<YourUsername>\LMStudio\Models\

- macOS: /Users//LMStudio/Models/

- Linux: /home//LMStudio/Models/

Шаг 7. Готово. Теперь локальные файлы DeepSeek полностью удалены с вашего компьютера.

Преимущества и недостатки локальной загрузки DeepSeek

Преимущества:

- Конфиденциальность и безопасность: Все ваши данные будут храниться на вашем устройстве. DeepSeek и другие сервисы не смогут получить доступ к вашей конфиденциальной информации.

- Оффлайн-доступ: После локальной установки DeepSeek не требует подключения к интернету. Вам не нужно беспокоиться о перегруженных серверах.

- Настраиваемость: Вы можете изменять поведение модели, подбирать запросы и корректировать выходные данные под свои нужды.

- Отсутствие ограничений по запросам: Вы не будете зависеть от ограничений API или квот использования, что позволит вам делать неограниченное количество запросов и экспериментов.

- Экономия средств: После загрузки модели вам не нужно платить за API-запросы или облачные вычисления, которые могут быть дорогостоящими при активном использовании.

Недостатки:

- Высокие системные требования: Для локального запуска DeepSeek требуются значительные вычислительные ресурсы. Если ваше устройство недостаточно мощное, работа с моделью может быть неудобной.

- Обслуживание: Вам придется обновлять модель и ее зависимости самостоятельно, что может отнимать время. Также, если возникнут ошибки или сбои, вам придется решать их самостоятельно.

- Энергопотребление: Запуск больших моделей требует много электроэнергии, особенно при использовании GPU, что может увеличить расходы на электричество.

Вывод

В целом, загрузить DeepSeek можно всего за несколько простых шагов. Все больше AI-энтузиастов изучают способы локального развертывания AI-инструментов, таких как ChatGPT, Gemini и Claude. Многие из них не имеют глубоких знаний в области компьютеров, но в процессе приобретают ценный опыт.

Если вы тоже начинающий пользователь, эта статья может помочь вам настроить собственного AI-ассистента на базе DeepSeek.